Analisis Bayesian sering kali melibatkan perhitungan kompleks, terutama ketika menghitung distribusi posterior pada model dengan parameter tinggi. Karena integral multidimensi sulit dipecahkan secara analitik, metode numerik seperti Monte Carlo dan Markov Chain Monte Carlo (MCMC) menjadi solusi penting (Gelman et al., 2013). So first thing first…

1. Mengapa Statistik Bayesian Membutuhkan Metode Numerik?

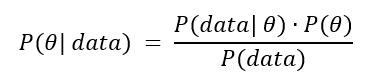

Statistik Bayesian sangat bergantung pada perhitungan distribusi posterior, sebagai hasil kombinasi antara prior dan likelihood:

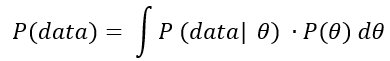

Namun, dalam praktiknya, menghitung integral dari seluruh kemungkinan parameter :

Integral ini tidak selalu dapat diselesaikan secara analitik, terutama jika:

- Modelnya kompleks,

- Parameter lebih dari satu (multi-dimensional),

- Atau bentuk distribusinya tidak standar.

Inilah alasan mengapa metode numerik sangat penting dalam Bayesian. Tanpa metode ini, kita tidak dapat:

- Menghitung distribusi posterior secara tepat,

- Melakukan estimasi parameter yang realistis,

- Maupun menghasilkan prediksi berbasis data.

Hubungan Antara Bayesian, Monte Carlo, dan MCMC

Dalam analisis Bayesian, pendekatan statistik yang digunakan memerlukan teknik sampling untuk mengaproksimasi distribusi posterior yang dihasilkan dari perkalian antara prior dan likelihood. Di sinilah metode Monte Carlo memainkan peran penting, karena teknik ini memanfaatkan simulasi acak (Nadinastiti, 2010) untuk menghitung ekspektasi statistik atau mendekati bentuk distribusi posterior melalui pengambilan sampel berulang.

Namun dalam praktiknya, seringkali kita dihadapkan pada situasi dimana distribusi target yang ingin kita sampling ternyata terlalu kompleks atau sulit diakses secara langsung. Pada kasus seperti inilah metode Markov Chain Monte Carlo (MCMC) menjadi solusi yang efektif (Medova, 2007). MCMC pada dasarnya merupakan pengembangan dari metode Monte Carlo yang dikombinasikan dengan properti rantai Markov, memungkinkan kita untuk mengambil sampel dari distribusi target yang kompleks sekalipun.

Proses kerja MCMC dimulai dengan membangun rantai Markov yang memiliki distribusi stasioner sesuai dengan distribusi posterior yang kita inginkan. Dengan memanfaatkan algoritma seperti Metropolis-Hastings atau Gibbs Sampling, MCMC mampu menghasilkan rangkaian sampel yang meskipun bersifat dependen (karena sifat Markov-nya), namun pada akhirnya akan konvergen ke distribusi target. Inilah yang membuat MCMC menjadi teknik yang sangat powerful dalam komputasi Bayesian modern, terutama ketika berhadapan dengan model statistik yang kompleks dan dimensi parameter yang tinggi.

2. Apa Itu Metode Monte Carlo?

Metode Monte Carlo (MC) mengandalkan pengambilan sampel acak (random sampling) untuk mendekati nilai ekspektasi atau probabilitas. Misalnya, untuk menghitung nilai π sebagaimana pada Gambar 1, kita bisa melemparkan titik-titik secara acak dalam sebuah persegi dan menghitung rasio titik yang jatuh di dalam lingkaran (Robert & Casella, 2004).

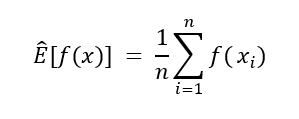

Misal kita ingin menghitung ekspektasi ![]() Kita cukup:

Kita cukup:

- Ambil Sampel acak

- Hitung:

Gambar 1: Monte Carlo menghitung luas lingkaran melalui titik-titik acak. Semakin banyak titik, semakin akurat estimasinya.

Ilustrasi: Monte Carlo menghitung luas lingkaran dalam kotak dengan menjatuhkan titik-titik acak. Titik yang jatuh dalam lingkaran dihitung dan dibandingkan dengan total titik untuk mendekati nilai π. Ilustrasi ini menggambarkan prinsip utama Monte Carlo ketika integral sulit dapat didekati lewat simulasi acak. Keunggulan utama metode ini terletak pada kemampuannya untuk menangani masalah dimensi tinggi yang tidak terjangkau oleh metode numerik tradisional, sementara kelemahan utamanya adalah laju konvergensi yang relatif lambat.

3. Apa Itu Metode Markov Chain Monte Carlo (MCMC)?

Metode MCMC adalah metode simulasi Monte Carlo yang lebih canggih, digunakan untuk mengambil sampel dari distribusi posterior yang rumit melalui proses rantai Markov. Metode ini menggabungkan dua konsep utama, yaitu Markov Chain (proses stokastik dimana keadaan berikutnya hanya bergantung pada keadaan saat ini) dan Monte Carlo (estimasi melalui pengambilan sampel).

Metode ini memungkinkan kita menghasilkan sampel dari distribusi posterior meskipun bentuknya tidak diketahui secara eksplisit. Dalam konteks Bayesian modern, Monte Carlo berfungsi sebagai tulang punggung untuk mengaproksimasi distribusi posterior yang kompleks, meskipun untuk kasus-kasus tertentu yang lebih rumit, pengembangannya dalam bentuk Markov Chain Monte Carlo (MCMC) menjadi lebih tepat digunakan.

Apa itu Rantai Markov?

Rantai Markov merupakan suatu proses stokastik yang memiliki sifat khusus dimana nilai atau keadaan saat ini hanya bergantung pada nilai atau keadaan sebelumnya (sifat Markovian), tanpa memerlukan informasi historis lengkap dari seluruh rangkaian sebelumnya. Dalam konteks Markov Chain Monte Carlo (MCMC), properti penting ini dimanfaatkan untuk membangun suatu mekanisme sampling yang cerdas. Proses ini dapat divisualisasikan sebagai partikel yang bergerak dalam ruang parameter, dimana setiap langkah perpindahannya hanya dipengaruhi oleh posisi saat ini, bukan oleh lintasan sebelumnya yang dilalui.

Gambar 2: Rantai Markov bergerak di ruang parameter, cenderung menuju area dengan densitas posterior tinggi.

Ilustrasi: Titik-titik MCMC berpindah mengikuti aturan probabilistik, tetapi semakin lama semakin banyak berada di daerah dengan densitas posterior tinggi.

Gambar 2 secara ilustratif menunjukkan bagaimana rantai Markov bergerak dinamis dalam ruang parameter. Pada awalnya, posisi titik-titik MCMC mungkin tersebar secara acak, namun seiring dengan berjalannya iterasi, titik-titik tersebut akan semakin cenderung berkumpul di daerah-daerah dengan densitas posterior tinggi. Fenomena ini terjadi karena algoritma MCMC dirancang untuk menerima perpindahan yang mengarah ke daerah dengan probabilitas lebih tinggi, sementara tetap memungkinkan (dengan probabilitas tertentu) untuk menerima perpindahan ke daerah dengan probabilitas lebih rendah – suatu mekanisme penting yang mencegah terjebaknya proses pada mode lokal.

Berbeda dengan metode Monte Carlo konvensional yang menghasilkan sampel independen, MCMC menghasilkan sampel yang berkorelasi melalui proses berantai ini. Korelasi antar sampel ini bukanlah kelemahan, melainkan strategi cerdas yang memungkinkan kita mengeksplorasi ruang parameter yang kompleks. Justru melalui ketergantungan inilah rantai Markov mampu secara bertahap menemukan dan kemudian mengeksplorasi daerah-daerah penting dari distribusi target. Seiring dengan bertambahnya iterasi, distribusi empiris dari sampel-sampel yang dihasilkan akan semakin mendekati distribusi target yang diinginkan, suatu properti yang dikenal sebagai konvergensi.

4. Dua Algoritma Populer dalam MCMC

a. Metropolis-Hastings (MH)

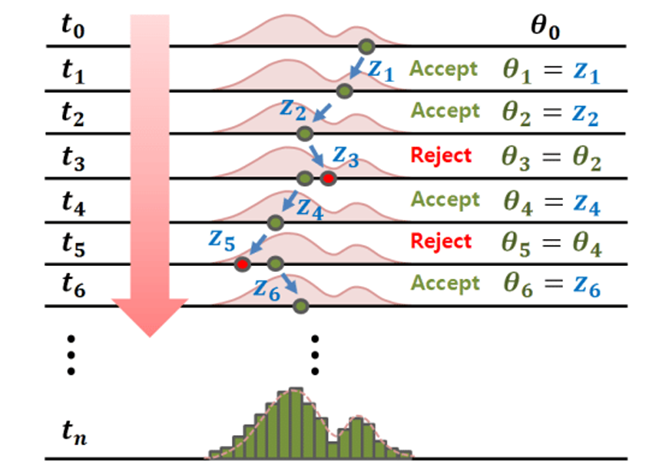

Dikembangkan pertama kali oleh Metropolis pada 1953 dan diperluas oleh Hastings pada 1970, algoritma Metropolis-Hastings merupakan tulang punggung dari metode MCMC. Algoritma ini bekerja dengan membangun rantai Markov yang memiliki distribusi stasioner sesuai dengan distribusi target (posterior) yang kita inginkan. Algoritma ini menggunakan distribusi proposal untuk menghasilkan kandidat sampel baru, kemudian menerima atau menolaknya berdasarkan acceptance ratio (Hastings, 1970).

Mekanisme kerjanya dimulai dengan memilih nilai awal ![]() (bisa dipilih secara acak atau berdasarkan estimasi awal). Pada setiap iterasi:

(bisa dipilih secara acak atau berdasarkan estimasi awal). Pada setiap iterasi:

1. Mulai dari nilai awal (misalnya ![]() )

)

2. Usulkan nilai baru ![]() dari distribusi proposal.

dari distribusi proposal.

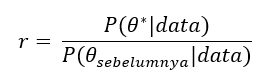

3. Hitung rasio:

4. Terima atau tolak ![]() berdasarkan probabilitas min (1, r)

berdasarkan probabilitas min (1, r)

Tujuannya: menghasilkan sampel yang mengikuti distribusi posterior.

b. Gibbs Sampling

Gibbs Sampling memanfaatkan conditional probability dari setiap parameter untuk menghasilkan sampel secara iteratif. Algoritma ini sangat efisien jika distribusi bersyarat (conditional distribution) mudah diambil sampelnya dan kita tahu bentuk distribusi kondisional antarparameter. Metode ini sangat cocok untuk model yang kompleks dan hierarkis.

Langkah-langkahnya:

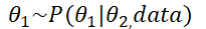

- Sampling

- Sampling

- Ulangi sampai cukup banyak sampel dihasilkan.

Contoh Kasus:

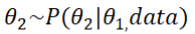

1. Monte Carlo: Melempar dadu untuk menghitung rata-rata

Jadi, kita menghitung rata-rata hasil lemparan dadu 6 sisi secara empirik, dengan proses sebagai berikut:

- Dadu dilempar sebanyak N kali (misal N = 1.000)

- Hasil dicatat disetiap lemparannya dengan rentang nilai 1 hingga 6.

- Hitunglah rata-rata dari semua hasil lemparan.

Syntax:

Output:

Dimana nilai ekspektasi teoritisnya adalah ![]() dan ketika nilai N besar maka hasil MC akan mendekati 3,5. Konsep MC ini tidak bergantung pada lemparan sebelumnya atau dengan kata lain dapat dikatakan bahwa setiap lemparan adalah independen. Metode MC ini cocok untuk estimasi nilai ekspektasi distribusi sederhana.

dan ketika nilai N besar maka hasil MC akan mendekati 3,5. Konsep MC ini tidak bergantung pada lemparan sebelumnya atau dengan kata lain dapat dikatakan bahwa setiap lemparan adalah independen. Metode MC ini cocok untuk estimasi nilai ekspektasi distribusi sederhana.

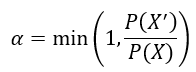

2. MCMC: Melempar dadu dengan ketergantungan Markov

Jadi, untuk menghasilkan sampel dari distribusi tertentu (misal: dadu yang lebih sering menghasilkan angka 4–6) dengan memastikan setiap lemparan bergantung pada hasil sebelumnya (Markov Property). Adapun prosesnya adalah sebagai berikut:

(Algoritma Metropolis-Hastings)

- Distribusi target:

dimana

dan

- Proposal:

Ajukan nilai baru (X’) dengan mengacak ±1 dari nilai saat ini (X).

Misalnya, jika X = 3, maka X’ bisa 2 atau 4.

- Acceptence Ratio:

dimana

Jika ![]() maka terima X’

maka terima X’

Jika ![]() maka terima dengan probabilitas

maka terima dengan probabilitas ![]()

Syntax:

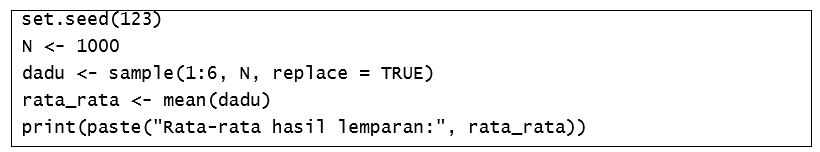

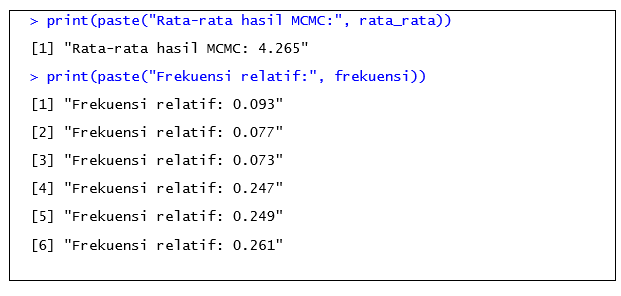

Output:

Berdasarkan hasil output, diperoleh rata-rata yang lebih tinggi dari 3,5, yakni 4,265 karena distribusi target lebih berat di angka 4 hingga 6. Selain itu, frekuensi relatif juga akan mendekati distribusi target. Dalam konsep MCMC, setiap lemparan bergantung pada nilai sebelumnya (proses Markov), sehingga cocok untuk sampling distribusi kompleks yang tidak bisa diambil sampelnya secara langsung.

Secara keseluruhan, dapat dibandingkan MC dan MCMC sebagai berikut:

| Aspek | Monte Carlo (MC) | MCMC |

| Ketergantungan | Independen | Bergantung pada nilai sebelumnya |

| Tujuan | Estimasi nilai ekspektasi | Sampling dari distribusi target |

| Contoh Kasus | Rata-rata dadu fair | Dadu dengan bobot tidak uniform |

Dimana metode MC cocok untuk masalah sederhana dengan distribusi diketahui, sedangkan MCMC digunakan ketika distribusi target kompleks dan sulit untuk di-sampel secara langsung (Robert & Casella, 2004).

Daftar Pustaka

Casella, G., & George, E. I. (1992). Explaining the Gibbs sampler. The American Statistician.

🔗https://www2.stat.duke.edu/~scs/Courses/Stat376/Papers/Basic/CasellaGeorge1992.pdf

Gelman, A., et al. (2013) – Bayesian Data Analysis, CRC Press

🔗 https://sites.stat.columbia.edu/gelman/book/BDA3.pdf

Hastings, W. K. (1970). “Monte Carlo Sampling Methods Using Markov Chains and Their Applications”. Biometrika.

🔗 https://www2.stat.duke.edu/~scs/Courses/Stat376/Papers/Basic/Hastings1970.pdf

Medova, Elena. (2007). Bayesian analysis and Markov chain Monte Carlo Simulation. Cambridge.

🔗 https://www.jbs.cam.ac.uk/wp-content/uploads/2020/08/wp0710.pdf

Nadinastiti. (2010). Metode Monte Carlo. Makalah II2092 Probabilitas dan Statistik, Institut Teknologi Bandung.

ResearchGate – Illustration of Markov Chain Monte Carlo Method

🔗https://www.researchgate.net/figure/llustration-of-Markov-Chain-Monte-Carlo-method_fig1_334001505

Robert, C. P., & Casella, G. (2004) – Monte Carlo Statistical Methods, Springer

🔗https://www.researchgate.net/publication/41222435_Monte_Carlo_Statistical_Method