Menurut (Trinata et al., 2024), Rantai Markov adalah metode yang menggambarkan perubahan suatu sistem dari satu keadaan ke keadaan lainnya, di mana perpindahan tersebut hanya ditentukan oleh kondisi saat ini tanpa dipengaruhi oleh kejadian sebelumnya. Salah satu jenisnya adalah Rantai Markov Diskrit, yaitu perubahan yang terjadi pada waktu-waktu tertentu yang terpisah. Dalam sistem ini terdapat state space, yakni kumpulan semua kemungkinan keadaan yang bisa terjadi, dan setiap keadaan memiliki peluang berpindah ke keadaan lain yang ditentukan melalui matriks probabilitas transisi.

Menurut (Trinata et al., 2024), Rantai Markov adalah metode yang menggambarkan perubahan suatu sistem dari satu keadaan ke keadaan lainnya, di mana perpindahan tersebut hanya ditentukan oleh kondisi saat ini tanpa dipengaruhi oleh kejadian sebelumnya. Salah satu jenisnya adalah Rantai Markov Diskrit, yaitu perubahan yang terjadi pada waktu-waktu tertentu yang terpisah. Dalam sistem ini terdapat state space, yakni kumpulan semua kemungkinan keadaan yang bisa terjadi, dan setiap keadaan memiliki peluang berpindah ke keadaan lain yang ditentukan melalui matriks probabilitas transisi.

A. Rantai Markov Waktu Diskrit

Misalkan kita mengamati suatu sistem pada waktu 0, 1, 2, dan seterusnya. Anggap Xn adalah keadaan sistem pada waktu ke. Sekarang kita berada diwaktu ke-10, artinya kita sudah tahu keadaan dari X0 sampai X10.

Pertanyaannya, apakah kita bisa memprediksi keadaan sistem diwaktu ke-11? Secara umum, X10 bisa saja dipengaruhi oleh semua keadaan sebelumnya, dari X10 sampai X10. Tapi ada penyederhanaan penting: jika seluruh riwayat itu diketahui, ternyata keadaan berikutnya cukup ditentukan oleh keadaan saat ini saja, yaitu X10.

Jadi, untuk memprediksi X10, kita tidak perlu lagi melihat X10 sampai X10, karena informasi itu sudah “terwakili” oleh X10. Kalau suatu sistem memiliki sifat seperti ini di setiap waktu, maka sistem tersebut dikatakan memiliki sifat Markov.

Berdasarkan gambaran di atas, secara sederhana menurut (Wardani Hulu et al., 2024), Proses Markov adalah suatu proses yang menyatakan bahwa kejadian di masa depan ditentukan oleh keadaan saat ini, dan tidak dipengaruhi oleh kejadian-kejadian di masa lalu.

Menurut (Kulkarni et al., 2011), Suatu proses stokastik {Xn; n ≥ 0} pada ruang keadaan S dikatakan sebagai rantai Markov waktu diskret (DTMC) jika, untuk semua i dan j di S:

P(Xn+1 = j | Xn = i) = P(Xn = j | Xn-1 = i)

Pada penelitian (Akhdan & Fauzy, 2023), peluang sistem berada pada keadaan j diwaktu berikutnya (n + 1), jika saat ini berada di keadaan i, sama dengan peluang berada di keadaan j sekarang jika sebelumnya berada di keadaan i. Peluang seperti ini disebut sebagai peluang transisi satu langkah.

P(Xn+1 = j | Xn = i)

berarti peluang berpindah dari keadaan ke keadaan dalam satu langkah waktu.

Contoh

Jika hari ini mahasiswa berada di state 1 (Malas), peluang besok dia berada di state 0 (Rajin) adalah 0,4 dan nilai ini tidak berubah kapanpun. Maka dapat ditulis

P(Xn+1 = 0 | Xn = 1) = P(Xn = 0 | Xn-1 = 1) = 0,4

Setiap bagian dari pernyataan diterjemahkan ke dalam simbol matematika. “Hari ini Malas” ditulis Xn = 1 , “besok Rajin” ditulis Xn+1 = 0 , dan “peluangnya 0,4 ” ditulis pada sisi kanan persamaan.

(Kulkarni, 2011), Untuk DTMC yang bersifat homogen, notasi singkat untuk probabilitas transisi satu langkah:

pi,j = P(Xn+1 = j | Xn = i), i, j = 1, 2, …, N

Maksudnya, pij adalah peluang sistem berpindah dari keadaan i ke keadaan j dalam satu langkah waktu. Yang perlu diperhatikan, pada DTMC yang bersifat homogen waktu, nilai peluang ini tidak berubah-ubah terhadap waktu. Jadi, meskipun waktunya berbeda, selama perpindahannya sama (dari i ke j), maka nilainya tetap.

(Kulkarni, 2011) juga menjelasakan bahwa Karena jumlah keadaan ada N, maka kemungkinan perpindahan yang terjadi ada sebanyak N2. Agar lebih mudah dipahami, semua peluang tersebut biasanya disusun dalam bentuk matriks berukuran N × N, yang ditulis sebagai P = [pij]

B. Matriks Transisi

Dalam Markov Chain Time Discrite dibentuk matriks N × N, dapat lebih mudah melihat dan mengolah peluang perpindahan antar setiap keadaan. Menurut (Akhdan & Fauzy, 2023), Matriks P disebut matriks probabilitas transisi pada DTMC karena berbentuk:

P = [pij], (matriks N × N)

Menurut (Firmayasari et al., 2025), persamaan di atas dapat dijabarkan:

pi,j = P(Xn+1 = j | Xn = i)

Matriks tersebut berisi peluang perpindahan dari satu keadaan ke keadaan lain dalam satu langkah. Cara membacanya sederhana: baris menunjukkan keadaan awal, sedangkan kolom menunjukkan keadaan tujuan. Jadi, setiap angka di dalam matriks adalah peluang berpindah dari suatu keadaan ke keadaan lain.

Contohnya, peluang berpindah dari keadaan 2 ke keadaan 3 dalam satu langkah bisa dilihat pada baris ke-2 dan kolom ke-3.

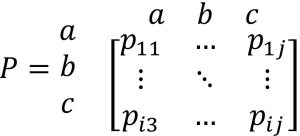

Menurut (Trinata et al., 2024), Adapun bentuk umum matriks peluang transisi rantai Markov adalah sebagai berikut:

Untuk kasus perpindahan yang lebih dari satu langkah, (Kulkarni et al., 2011) menulis persamaan:

P2 = P × P

P3 = P2 × P

Pn = Pn−1 × P

Pn, untuk n = banyak langkah

Bentuk matriks probabilitas transisi dengan keadaan a, b, c. Intinya, setiap baris mewakili keadaan awal (misalnya dari a, b, atau c), sedangkan setiap kolom menunjukkan keadaan tujuan. Nilai pij di dalam matriks menyatakan peluang berpindah dari keadaan i ke keadaan j. Misalnya pab adalah peluang dari keadaan a ke b.

Contoh

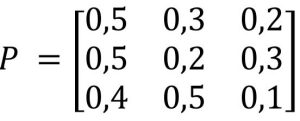

Kondisi lalu lintas di suatu kota dikelompokkan sebagai lancar, padat, atau macet. Misalkan kondisi lalu lintas besok hanya bergantung pada kondisi hari ini sebagai berikut: jika hari ini lancar, besok menjadi padat dengan probabilitas 0,3 dan macet dengan probabilitas 0,2; jika hari ini padat, besok menjadi lancar dengan probabilitas 0,5 dan macet dengan probabilitas 0,3; dan jika hari ini macet, besok menjadi lancar dengan probabilitas 0,4 dan padat dengan probabilitas 0,5. Modelkan kondisi lalu lintas tersebut sebagai DTMC.

Misalkan Xn adalah kondisi Jalanan di Kota Makassar pada hari ke-n, didefinisikan sebagai berikut:

Xn = 1 jika hari ke−n lancar

Xn = 2 jika hari ke−n padat

Xn = 3 jika hari ke−n macet

Maka kita diberitahu bahwa {Xn; n ≥ 0} adalah DTMC dengan ruang keadaan {1,2,3}. Selanjutnya kita hitung matriks transisinya. Diberikan bahwa p1,2 = 0,3 dan p1,3 = 0,2.Untuk p1,1 Kita gunakan

p1,1 + p1,2 + p1,3 = 1

untuk mendapatkan p1,1 = 0,5. Demikian pula, kita dapat mendapatkan p2,2 dan p3,3. Ini menghasilkan matriks probabilitas transisi:

C. Distribusi Steady State

Setelah memahami perilaku jangka pendek melalui matriks transisi, terdapat kondisi yang disebut sebagai steady state atau keadaan stabil. Menurut (Wardani Hulu et al., 2024), steady state dalam konteks Rantai Markov adalah kondisi di mana distribusi probabilitas keadaan sistem tidak lagi berubah seiring berjalannya waktu. Sederhananya, steady state adalah titik di mana sistem sudah mencapai keseimbangan, tidak peduli dari kondisi mana sistem bermula, pada akhirnya peluang setiap keadaan akan menetap pada nilai yang tetap dan konstan.

Untuk mencapai kondisi tersebut, vektor distribusi probabilitas π harus memenuhi persamaan berikut (Wardani Hulu et al., 2024):

πP = π

Diuraikan menjadi:

πP – π = 0

π(P – 1) = 0

Persamaan ini berarti bahwa ketika distribusi probabilitas π dikalikan dengan matriks transisi P, hasilnya tetap sama yaitu π itu sendiri. Selain persamaan tersebut, terdapat satu syarat tambahan yang wajib dipenuhi, yaitu seluruh nilai πi tidak boleh bernilai negatif dan jumlah keseluruhannya harus tepat sama dengan satu (Akhdan & Fauzy, 2023):

![]()

Adapun untuk menghitung nilai peluang pada setiap keadaan diwaktu ke-n, digunakan rumus berikut (Kulkarni et al., 2011):

![]()

sistem berada di keadaan j pada waktu ke- diperoleh dengan menjumlahkan seluruh kemungkinan keadaan awal dikalikan dengan peluang transisi dari i menuju j sebanyak n langkah. Semakin besar nilai n, maka hasil perhitungan akan semakin mendekati nilai steady state yang stabil dan tidak lagi berubah.

Contoh

Pada kasus sebelumnnya, mahasiswa dengan kondisi Rajin (state 0) dan Malas (state 1), kita sudah mengetahui matriks transisi satu langkahnya adalah:

![]()

Dalam jangka panjang, berapa peluang mahasiswa itu berada dalam kondisi Rajin dan berapa peluang dia Malas? Untuk menjawab itu, hitung steady state-nya.

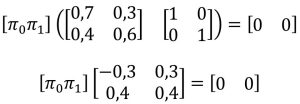

Gunakan Persamaan :

π(P – 1) = 0

Lalu lakukan perkalian pada matriks:

Dengan syarat:

![]()

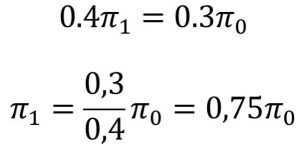

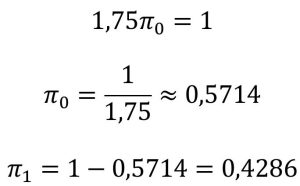

Menyelesaikan persamaan (1):

Substitusi ke persamaan (3):

![]()

Sehingga bentuk matriks steady state:

![]()

Dalam jangka panjang, peluang mahasiswa berada pada kondisi rajin adalah sekitar 57,14%, sedangkan kondisi malas sekitar 42,68%. Ini berarti orang tersebut lebih sering berada dalam kondisi rajin, tetapi masih cukup sering juga menjadi malas. Dengan kata lain, perilakunya cenderung rajin, namun belum sepenuhnya stabil karena masih ada kemungkinan berubah menjadi malas.

Refrensi

Akhdan, A., & Fauzy, A. (2023). Pendekatan rantai markov waktu diskrit dalam memprediksi penurunan dan kenaikan jumlah pelanggan air minum baru PDAM Kota Surakarta. Emerging Statistics and Data Science Journal, 1(2), 309–319. https://journal.uii.ac.id/esds/article/view/27001

Firmayasari, D. S., Nurhalisa, & Hidayat, I. T. (2025). Aplikasi rantai Markov untuk estimasi probabilitas return saham INDF periode April-Juli 2025. Jurnal Matematika, 15(2), 98–105. https://doi.org/10.24843/JMAT.2025.v15.i02.p189

Kulkarni, V. G. (2011). Introduction to modeling and analysis of stochastic systems (2nd ed.). Springer. https://doi.org/10.1007/978-1-4419-1772-0

Trinata, A. S., Auqi B. B., S. F., Alisyahbana, I. U., Haikal, I., & Mardhotillah, B. (2024). Pemodelan perilaku peralihan platform QRIS di Program Studi Matematika Universitas Jambi: Analisis rantai Markov yang terintergrasi dengan wawasan kualitatif. Multi Proximity: Jurnal Statistika Universitas Jambi, 3(1). https://online-journal.unja.ac.id/multiproximity

Wardani Hulu, W., Hasibuan, T. N., Lubis, W. N., Manullang, S., & Amalia, S. N. (2024). Evaluasi perencanaan produksi kubis di Sumatera Utara dengan metode rantai Markov waktu diskrit. Konstanta: Jurnal Matematika dan Ilmu Pengetahuan Alam, 2(3), 48–58. https://doi.org/10.59581/konstanta-widyakarya.v2i3.3736